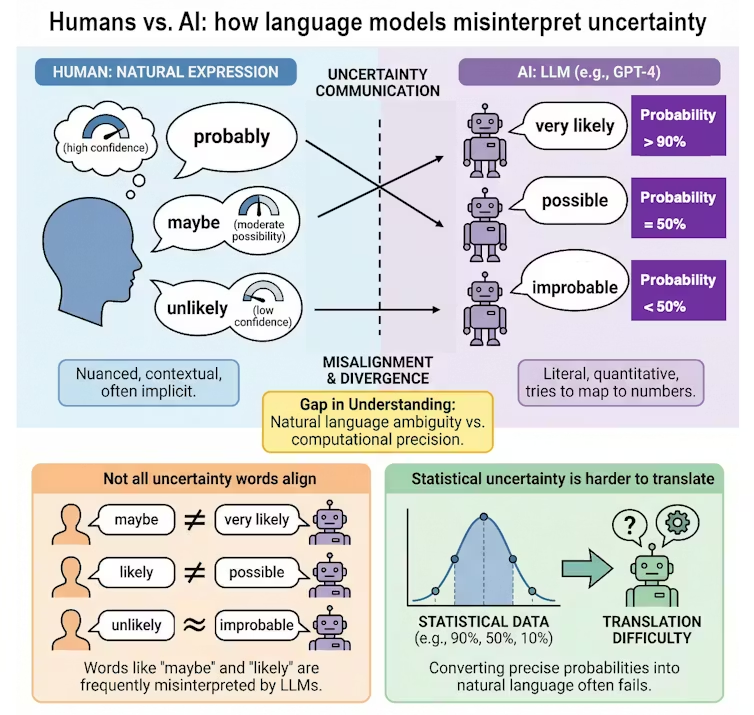

Когда человек говорит, что событие «вероятно» или «возможно», у людей обычно есть общее, пусть и размытое, понимание того, что это значит. Но когда тот же самый термин использует ИИ-чатбот вроде ChatGPT, он оценивает шансы совсем не так, как мы, выяснили я и мои коллеги.

Недавно мы опубликовали исследование в журнале NPJ Complexity, которое предполагает, что, хотя ИИ на базе больших языковых моделей (LLM) отлично справляются с ведением беседы, они часто не могут согласовать с людьми передачу неопределенности. Исследование было сосредоточено на словах, выражающих предположительную вероятность (estimative probability), таких как «может быть», «вероятно» и «почти наверняка».

Сравнивая, как ИИ-модели и люди сопоставляют эти слова с числовыми процентами, мы обнаружили значительные расхождения между людьми и большими языковыми моделями. Хотя модели, как правило, согласуются с людьми в крайних оценках, таких как «невозможно», они резко расходятся в уклончивых словах вроде «может быть». Например, модель может использовать слово «вероятно» для обозначения 80-процентной вероятности, в то время как человек-читатель предполагает, что оно означает что-то ближе к 65%.

Это может быть связано с тем, что люди могут интерпретировать такие слова, как «вероятно» и «возможно», основываясь на контекстуальных подсказках и личном опыте. Напротив, большие языковые модели могут усреднять противоречивое употребление этих слов в своих обучающих данных, что и приводит к расхождениям с человеческими интерпретациями.

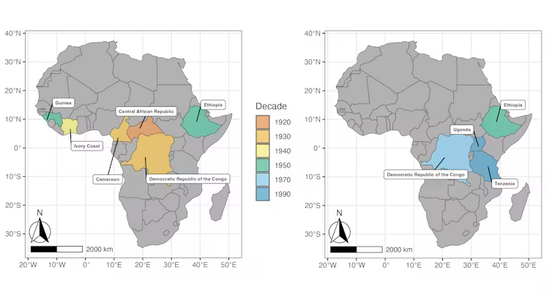

Наше исследование также показало, что большие языковые модели чувствительны к гендерно-обусловленному языку и конкретному языку, используемому в подсказке (промпте). Когда в промпте «он» менялось на «она», вероятностные оценки ИИ часто становились более жесткими, отражая предубеждения, заложенные в его обучающих данных. Когда промпт менялся с английского на китайский, вероятностные оценки ИИ часто смещались, возможно, из-за различий между английским и китайским языками в том, как люди выражают и понимают неопределенность.

Почему это важно

Это не просто лингвистический курьез. Такое рассогласование представляет собой фундаментальную проблему для безопасности ИИ и взаимодействия человека и ИИ. Поскольку большие языковые модели все чаще используются в таких важных областях, как здравоохранение, государственная политика и научная отчетность, то, как они сообщают о риске, становится вопросом общественного доверия.

Если ИИ-ассистент, помогающий врачу, например, описывает побочный эффект как «маловероятный», но внутренний расчет модели для «маловероятно» намного выше, чем интерпретация врача, итоговое решение может оказаться ошибочным.

Какие еще исследования ведутся

Ученые изучают, как люди количественно оценивают неопределенность, с 1960-х годов — эта область была пионерской разработкой аналитиков ЦРУ для улучшения разведывательных отчетов. Совсем недавно произошел взрывной рост литературы по большим языковым моделям, стремящейся заглянуть под капот нейронных сетей, чтобы лучше понять их «поведение» и лингвистические паттерны.

Наше исследование добавляет уровень сложности, рассматривая взаимодействие между человеком и искусственным интеллектом как биологическую систему, в которой значение может искажаться. Оно выходит за рамки простого измерения того, «умен» ли ИИ, и вместо этого задается вопросом, согласован ли он с человеческими представлениями.

Другие исследователи в настоящее время изучают, может ли так называемое «цепочное мышление» (chain-of-thought prompting), когда ИИ просят показать ход своих рассуждений, исправить эти ошибки. Однако наше исследование показало, что даже продвинутые рассуждения не всегда устраняют разрыв между статистическими данными и словесными оценками.

Цель будущего развития ИИ — создание моделей, которые не просто предсказывают следующее вероятное слово, но действительно понимают вес той неопределенности, которую они передают. Исследователи призывают к разработке более надежных метрик согласованности, чтобы гарантировать: если модель видит 10%-й шанс в данных, она каждый раз выбирает одно и то же слово для его обозначения.

По мере того как мы движемся к миру, где ИИ будет реферировать научные статьи и управлять расписаниями людей, обеспечение того, чтобы «вероятно» означало именно «вероятно», является жизненно важным шагом на пути превращения этих систем в надежных партнеров, а не просто в сложных попугаев.

Это исследование поднимает важный вопрос не только о точности ИИ, но и о природе доверия в эпоху алгоритмов. Когда мы делегируем машинам принятие решений или хотя бы помощь в них, мы неявно предполагаем, что они разделяют наши когнитивные и лингвистические рамки. Однако, как выясняется, даже такое, казалось бы, простое слово, как «вероятно», может стать камнем преткновения. ИИ, обученный на текстах, где «вероятно» использовалось в самых разных контекстах (от научных статей до бытовых разговоров), вырабатывает свое «усредненное» значение, которое может не совпадать с ожиданиями конкретного пользователя.

Проблема усугубляется в мультикультурном и мультиязычном контексте. То, что считается высокой степенью уверенности в одной культуре, может выражаться гораздо более осторожно в другой. И если ИИ, обученный преимущественно на англоязычных данных, начнет давать консультации на китайском или русском, риск недопонимания возрастает многократно. Поэтому будущее развитие безопасного ИИ лежит не только в плоскости улучшения алгоритмов, но и в глубоком понимании человеческой психологии и культурной лингвистики. Нам нужны не просто «умные» машины, а машины, которые говорят с нами на одном языке — во всех смыслах этого слова.

Поделитесь в вашей соцсети👇

Ваш комментарий